Waarom die Taylor Swift-deepfake van Trump het ergste niet is

IN ‘T KORT

– AI-technologieën zoals chatbots en beeldgeneratoren worden steeds meer gebruikt in verkiezingscampagnes, waardoor de bezorgdheid over hun invloed op de democratie toeneemt.

– Meer dan de helft van de Amerikaanse kiezers vreest dat AI-gedreven desinformatie invloed kan hebben op de uitkomst van de presidentsverkiezingen in 2024.

– Voorbeelden van misbruik van generatieve AI in politieke contexten omvatten audiodeepfakes in Slowakije en een AI-gegenereerde apocalyptische video door de Republikeinse partij in de VS.

– Ondanks de groeiende integratie van AI in politieke campagnes, toonde onderzoek van The New York Times aan dat veel politieke campagneteams terughoudend zijn om openlijk AI-technologieën te omarmen.

– Desinformatieonderzoekers waarschuwen voor het ‘leugenaarsdividend’, waarbij het moeilijker wordt om feiten van fictie te onderscheiden, wat een ernstige bedreiging vormt voor de democratie.

Worden de Amerikaanse presidentsverkiezingen de eerste waarin AI écht een belangrijke rol speelt? Voorlopig valt het mee.

Al enkele jaren, sinds de opkomst van praktische toepassingen op basis van artificiële intelligentie (AI), wordt voorspeld dat die een grote impact zullen hebben op verkiezingscampagnes – en mogelijk zelfs de democratie zouden kunnen verstoren. AI-chatbots en -beeldgeneratoren zijn in staat om realistische teksten en beelden te maken die lijken op menselijke producten. Geregeld worden ze verward met de werkelijkheid.

Tegelijkertijd zijn AI-tools stilaan ingeburgerd geraakt. Miljoenen mensen gebruiken ChatGPT, en beeldgeneratie met AI zie je al in grote advertentiecampagnes, van de affiches voor de Gentse Feesten tot reclame voor de Nationale Loterij. Dus waarom zouden ook politici er geen gebruik van maken?

De potentiële invloed van AI op verkiezingen leeft bij kiezers. Uit een recente poll van Morning Consult/Axios in de VS antwoordde meer dan de helft van de bevraagden bevestigend op de vraag of ze dachten dat ‘desinformatie verspreid door AI een impact zal hebben op wie de presidentsverkiezingen wint in 2024’. Maar is die bezorgdheid wel terecht?

Gekloonde stem

Het klopt dat er de voorbije jaren in verschillende landen al enkele verontrustende casussen waren van misbruik van generatieve AI. In Slowakije circuleerden audiodeepfakes met de gekloonde stem van een linkse oppositiekandidaat. De Republikeinse partij maakte in de VS eerder al een apocalyptisch filmpje, volledig met AI-beeldtechnologie gemaakt, over hoe een nieuwe termijn voor Joe Biden als president er zou uitzien.

Maar in de huidige strijd tussen Donald Trump en Kamala Harris blijkt AI slechts in beperkte mate aan de basis te liggen van het circulerende nepnieuws of andere misleidende berichten. Het News Literacy Project, een Amerikaanse ngo die mensen wil wapenen tegen desinformatie, turfde in totaal 561 gevallen van virale desinformatie over de presidentsverkiezingen, waarvan slechts 8 procent terug te voeren viel op generatieve AI. Een ‘AI-tsunami’ is dat niet.

Targeting

De pers houdt het gebruik van AI-toepassingen door politieke campagnes nauwlettend in het oog. In The New York Times verscheen vorige week een artikel over de talrijke AI-bedrijfjes die politici aanbieden om AI los te laten op hun campagnemateriaal. Ze bieden dan bijvoorbeeld chatbots aan die met potentiële kiezers kunnen praten in de stijl van de kandidaat, of geïndividualiseerde berichten waarin een politicus mensen persoonlijk aanspreekt met getargete campagneboodschappen, afgestemd op hun eigen kiezersprofiel.

Uit het onderzoek van The New York Times bleek dat de meeste politieke campagneteams niet meteen stonden te springen om met AI-technologie te werken – of toch niet openlijk. Slechts enkele politici gaven toe AI te gebruiken, de meesten dan nog alleen achter de schermen. En wie het gebruikt had, was niet onder de indruk van de effecten ervan.

Deepfake Swift

Toch is AI-inhoud niet helemaal afwezig bij de Amerikaanse presidentsverkiezingen. Net omdat iedereen met AI aan de slag kan gaan, circuleren de resultaten daarvan volop op sociale media. De meeste AI-gegenereerde afbeeldingen en filmpjes over de presidentsverkiezingen zijn niet bedoeld om te misleiden, maar eerder om te bespotten. Zo is er een AI-video waarin Trump en Harris een liefdesrelatie krijgen – op het einde bevalt Harris zelfs van een kleine baby-Trump. Een ander AI-filmpje toont hoe verschillende Amerikaanse politici gewapend een supermarkt overvallen. Ook populair zijn parodieën van campagnefilmpjes of politieke toespraken, waarbij men met door AI gekloonde stemmen de politici allerlei grove uitspraken laat doen.

Slecht 8% van de virale desinformatie over de presidentsverkiezingen komt van generatieve AI.

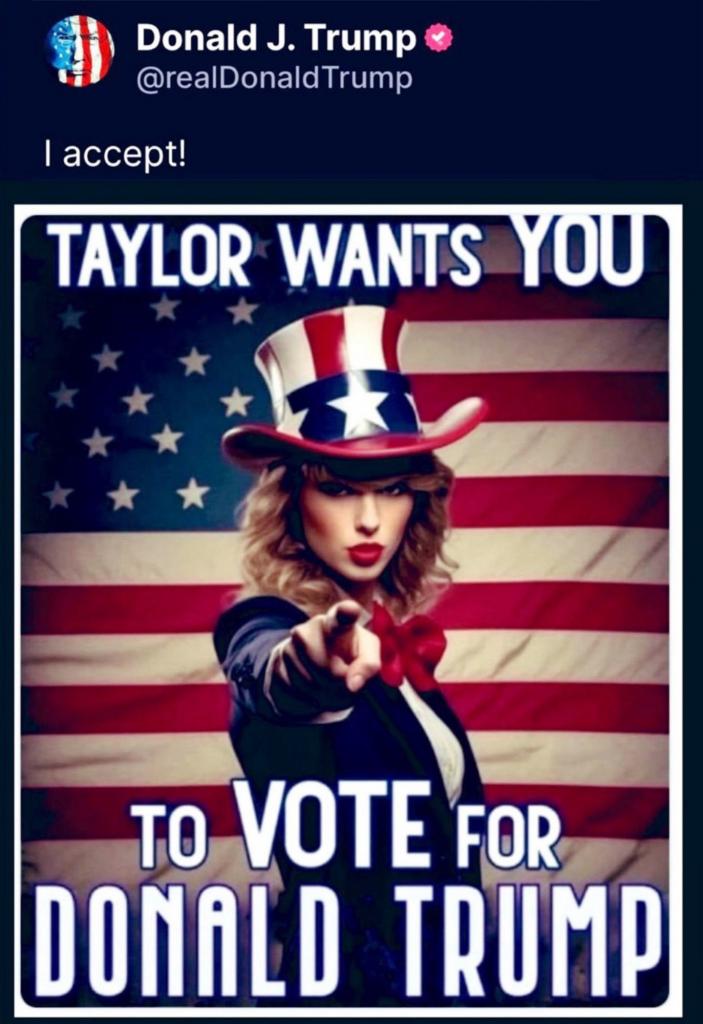

Soms worden die spielereien opgepikt door de politieke kandidaten, of door influencers met een groot bereik zoals Elon Musk. Eerder deze maand deelde Trump op zijn socialemediakanaal Truth Social enkele afbeeldingen die insinueerden dat hij gesteund werd door popster Taylor Swift. (Er wordt al langer gezegd dat wanneer Swift, die een bijzonder grote en trouwe schare fans heeft, een oproep zou doen om voor een bepaalde kandidaat te stemmen, dat een grote impact zou hebben op de verkiezingen.) Een daarvan was een AI-afbeelding van Swift in een Uncle Sam-pakje, met de oproep om voor hem te stemmen, vergezeld van foto’s van jonge vrouwen met T-shirts met daarop de slogan ‘Swifties for Trump’.

Van de afbeeldingen die Trump deelde, was maar een deel met behulp van AI vervaardigd. Twee foto’s waren van een échte vrouw die op een Trump-campagnebijeenkomst gefotografeerd werd met een zelfgemaakt ‘Swifties for Trump’-T-shirt.

Hoe artificiële intelligentie ook de geschiedenis kan vervalsen

Leugenaarsdividend

De vraag is hoeveel mensen AI-producten voor werkelijkheid nemen. Fans van Taylor Swift weten bijvoorbeeld wel dat de zangeres geen fan is van Trump – bij de vorige verkiezingen riep ze al op om voor de Democratische partij te stemmen. AI-beeldgeneratie toont zich ook hier vooral geschikt voor beeldvorming: in een handomdraai maak je er prentjes mee om kiezers te waarschuwen of zelfs bang te maken voor fenomenen waar (nog) geen bestaand beeldmateriaal van bestaat.

Het ergste scenario is: mensen die feiten en werkelijke gebeurtenissen afwijzen ‘omdat ze evengoed met AI gemaakt konden zijn’.

Desinformatieonderzoekers vrezen daarom niet zozeer voor situaties waarbij kiezers een stortvloed aan AI-producten voor werkelijkheid nemen, maar voor het omgekeerde: burgers die feiten en werkelijke gebeurtenissen afwijzen of in twijfel trekken omdat ze ‘evengoed met AI gemaakt konden zijn’. Ook Donald Trump bezondigde zich daar al aan. Al weken windt hij zich op over de mensenmassa’s die opdagen voor campagnerally’s van Kamala Harris. Toen er een foto verscheen van een grote troep volk die haar opwachtte in een luchthavenhangar beweerde Trump dat het beeld nep was: ‘Er was niemand bij het vliegtuig; ze “AI-de” het om een enorme “menigte” van zogenaamde volgers te laten zien, MAAR ZE BESTONDEN NIET!” Het talrijke publiek was nochtans helemaal echt.

Het voorval sluit aan bij een ander kwalijk neveneffect van desinformatie op basis van AI: het ‘leugenaarsdividend’. Stel je voor dat binnenkort een audiofragment met onwelgevallige uitspraken of een scabreuze foto van een kandidaat opduikt. Sinds de komst van AI kan een politicus relatief straffeloos beweren die ‘allemaal fake’ zijn, wegens ‘gemaakt met AI”’ Dat argument kan vervolgens een deel van de kiezers overtuigen of minstens aan het twijfelen brengen. Conclusie? Politieke deepfakes van Taylor Swift zijn zonder twijfel onkies. Maar een veralgemeende twijfel over de werkelijkheid is waarschijnlijk de ernstigste bedreiging voor de democratie.

Wat bedrijven van Taylor Swift kunnen leren

Amerikaanse verkiezingen 2024

Fout opgemerkt of meer nieuws? Meld het hier